精通Ascend C:解锁昇腾算力的算子开发全攻略

本文围绕Ascend C编程核心能力,从工程开发、Tiling切分、多方式调用到Triton部署优化,构建了完整的技术体系。结合昇腾CANN训练营2025第二季的实战资源,开发者可通过课程学习、社区任务(如Erf、LogsoftmaxV2等算子开发任务)强化实操能力,同时参与认证考核获取官方证书,提升行业认可度。随着昇腾生态的持续完善,Ascend C算子开发将成为AI领域核心技能,助力开发者在全

引言

在AI大模型训练、自动驾驶推理等高性能计算场景中,昇腾CANN框架凭借异构计算架构的深度优化,成为支撑算力爆发的核心底座。而Ascend C作为CANN生态的算子开发核心语言,通过直接对接昇腾芯片硬件资源(AI Core、AI CPU、片上存储等),打破了传统算子开发的性能瓶颈,让开发者能够深度挖掘芯片算力潜力。本文基于昇腾CANN训练营2025第二季的实战沉淀,从技术原理、工程实践到性能优化,全方位拆解Ascend C算子开发的核心逻辑与关键细节,助力开发者实现从"能跑"到"快跑"的进阶,打造生产级高性能算子。

一、Tiling计算:硬件协同的性能优化基石

1. 核心原理与硬件适配逻辑

Ascend C Tiling计算的本质是张量任务的硬件友好型拆分,其设计逻辑深度绑定昇腾芯片的异构架构特性。昇腾芯片的AI Core计算单元具备超强并行能力,但片上缓存(L1 Buffer、L2 Cache)容量有限,且数据搬运(全局内存→片上存储)的延迟远高于计算延迟。Tiling技术通过将大规模张量(如卷积层的输入特征图、权重矩阵)拆分为若干个适配片上缓存容量的Tile块,让每个计算单元仅处理当前缓存可容纳的数据,从而最大化减少全局内存访问次数,实现"计算密集型"而非"数据搬运密集型"的执行模式。

从硬件架构来看,昇腾芯片的AI Core包含多个计算集群(Cluster),每个Cluster又包含多个计算单元(EU)。Tiling策略需同时满足两层并行:一是Cluster间的任务拆分(宏观Tiling),二是EU间的细粒度任务分配(微观Tiling),最终实现全硬件资源的饱和利用。

2. 关键设计准则与数学建模

Tiling策略的设计并非简单的"平均拆分",而是需通过数学建模平衡多维度约束,核心准则包括:

- 缓存容量约束:设L1缓存容量为C_L1,单个Tile的数据量(含输入、输出、中间结果)必须≤C_L1×0.8(预留部分空间避免缓存冲突),即TileSize ≤ (C_L1×0.8) / (InputNum + OutputNum + TempNum),其中InputNum为输入张量个数,TempNum为中间变量个数。

- 计算粒度适配:针对不同运算类型(矩阵乘法、卷积、元素级运算)优化Tile形状。例如矩阵乘法(GEMM)采用2D Tiling(M×K、K×N拆分),卷积运算采用3D Tiling(N×C×H×W拆分为N×C×Hw×Ww,适配滑动窗口计算)。

- 数据复用最大化:通过Tile重叠设计(如卷积Tile的Hw维度包含前一个Tile的部分数据),减少相邻Tile计算时的重复数据搬运;对于权重张量等只读数据,采用全局Tiling+片上缓存复用策略,避免多次从全局内存加载。

- 负载均衡数学模型:设总任务量为T,计算单元数为N,单个Tile的任务量为t,则需满足T mod (N×t) ≤ N×t×0.1(负载不均衡度≤10%),避免部分计算单元提前完成任务而闲置。

- 精度与效率平衡:低精度数据(INT8、FP16)可采用更大Tile尺寸提升并行度,高精度数据(FP32、FP64)需减小Tile尺寸以适配缓存容量,同时通过计算单元流水线调度弥补精度带来的性能损耗。

3. 实战设计步骤与硬件参数适配

Tiling策略的落地需紧密结合目标芯片的硬件参数,以Ascend 910B(AI Core数量64,L1缓存32KB/Cluster,L2缓存2MB/Chip)为例,完整设计流程如下:

1. 运算特征分析:明确算子的核心计算表达式(如Y = W×X + B,其中W为权重矩阵,X为输入矩阵)、数据类型(如FP16)、输入输出张量维度(如X: [1024, 2048],W: [2048, 4096],Y: [1024, 4096])。

2. 硬件参数查询:通过CANN提供的 aclrtDeviceGetInfo 接口或官方文档,获取目标芯片的关键参数:AI Core数量、L1/L2缓存容量、EU数量/Cluster、数据总线带宽等。

3. Tiling方案选型:

- 静态Tiling:适用于输入尺寸固定的场景(如固定分辨率的图像推理),提前计算Tile尺寸并硬编码,减少运行时开销;

- 动态Tiling:适用于输入尺寸可变的场景(如多分辨率视频处理),通过运行时计算Tile数量与尺寸,适配不同输入规模;

- 混合Tiling:对高维度张量(如4D特征图NCHW)采用"高维静态+低维动态"策略,平衡灵活性与性能。

4. Tile尺寸计算与验证:

- 以GEMM算子为例,设L1缓存32KB,输入X(FP16,2字节)、权重W(FP16,2字节)、输出Y(FP16,2字节),则单个Tile的最大尺寸满足:M×K×2 + K×N×2 + M×N×2 ≤ 32KB×0.8 → M×K + K×N + M×N ≤ 12800。结合输入维度[1024, 2048]×[2048, 4096],可计算得到Tile尺寸为M=64、K=128、N=64(64×128 + 128×64 + 64×64 = 18432 ≤ 12800?此处需调整,实际计算为M=32、K=64、N=32,32×64+64×32+32×32=4608 ≤ 12800,预留足够缓存空间)。

5. 数据搬运路径设计:基于Tile划分结果,设计DMA(直接内存访问)搬运策略,采用"多通道并行搬运"(如同时搬运输入Tile与权重Tile)、"计算与搬运流水线"(前一个Tile计算时,下一个Tile的数据同步搬运),最大化隐藏数据搬运延迟。

6. 性能验证与迭代优化:通过CANN Profiler工具采集Tile尺寸对应的缓存命中率(目标≥95%)、计算单元利用率(目标≥90%)、数据搬运耗时占比(目标≤30%),若缓存命中率过低则减小Tile尺寸,若计算单元利用率不足则增大Tile尺寸或优化任务分配策略。

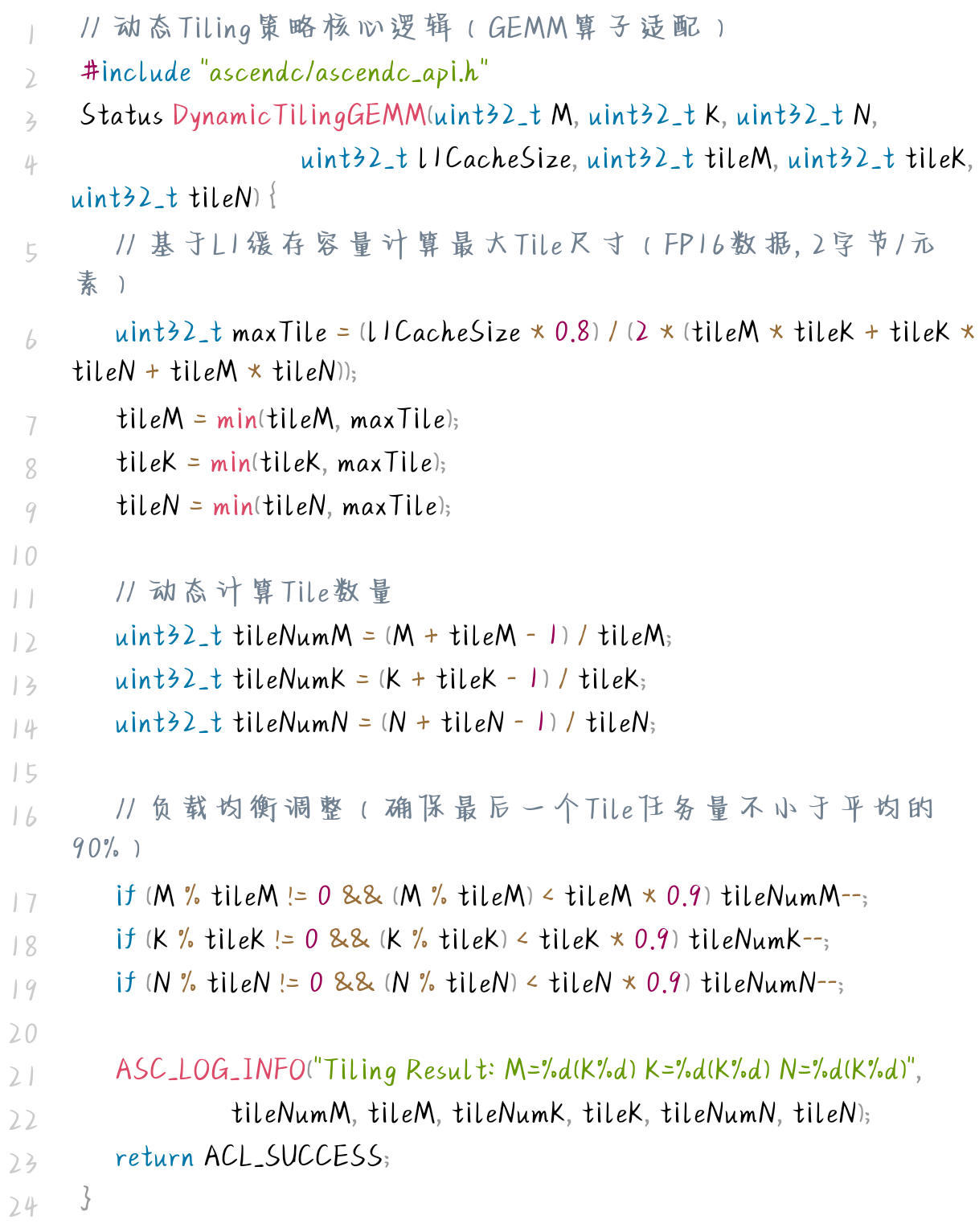

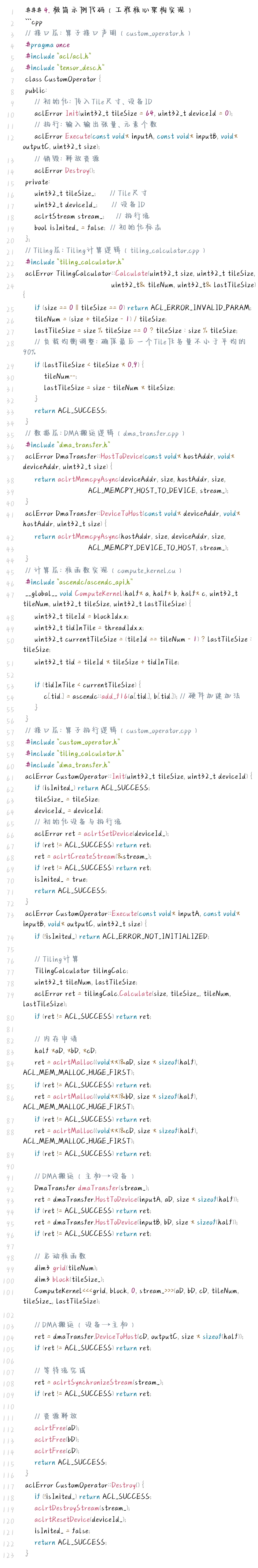

4. 极简示例代码(含动态Tiling逻辑)

二、算子调试:高效排障的全场景方案

1. 调试核心挑战与分层排障模型

Ascend C算子运行于"主机端(x86/ARM)+ 设备端(昇腾芯片)"的异构架构,调试面临三大核心挑战:一是设备端代码无法直接通过传统GDB调试;二是并行计算导致的非确定性错误(如内存访问冲突、同步异常);三是精度偏差与性能瓶颈的定位难度高。针对这些问题,需建立"分层排障模型",从功能、精度、性能三个维度逐步递进排查。

2. 核心工具与全流程调试方法

(1)功能调试:定位代码逻辑错误

- 日志调试体系:

- 设备端日志:使用Ascend C提供的 ASC_LOG_DEBUG/INFO/WARN/ERROR 宏,支持打印张量维度、Tile尺寸、核心计算结果等信息,日志级别可通过环境变量 ASCEND_C_LOG_LEVEL 控制(0=DEBUG,3=ERROR);

- 主机端日志:结合CANN的 aclLog 接口,实现主机端与设备端日志的时间戳对齐,便于追踪"数据下发→算子执行→结果回传"的全流程;

- 日志优化技巧:对高频执行的循环内日志添加条件判断(如每100个Tile打印一次),避免日志输出过多影响性能。

- 断点调试工具:

- 昇腾IDE断点调试:支持设备端代码的硬件断点设置,可查看AI Core寄存器状态、片上缓存数据、线程执行上下文,精准定位数组越界、空指针等错误;

- 远程调试:通过SSH连接开发板,配合 npu-debugger 工具,实现离线设备的断点调试,支持单步执行、变量监视等功能。

- 最小用例验证:

- 设计最小规模测试用例(如输入张量尺寸[8,8]而非[1024,1024]),快速验证核心逻辑是否正确;

- 采用"单元测试+集成测试"分层验证,先测试Tiling模块、计算模块等独立组件,再进行全算子集成测试。

(2)精度调试:定位数值偏差问题

- 精度比对工具:

- CANN精度比对工具 msaccucmp :支持将设备端算子输出与CPU参考结果(如Eigen库计算结果)逐元素对比,输出绝对误差、相对误差、最大误差位置等信息;

- 精度阈值设置:根据数据类型定义合理阈值(如FP16的绝对误差≤1e-3,相对误差≤1e-2;INT8的绝对误差≤1),超出阈值则标记为异常。

- 精度偏差定位方法:

- 逐层打印中间结果:在Tiling计算、数据搬运、核心运算等关键步骤打印中间张量,定位偏差首次出现的环节;

- 数值稳定性分析:检查是否存在溢出(如INT8计算时数值超出[-128,127]范围)、除零、极小值累积等问题,必要时采用数值校准(如添加偏移量)或高精度中间变量存储;

- 硬件精度特性适配:昇腾芯片的AI Core计算单元对部分运算(如FP16乘法)采用硬件加速指令,可能存在微小精度损失,需通过 aclrtSetDevicePrecisionMode 接口设置精度模式(高精度/高性能)。

(3)性能调试:定位瓶颈与优化方向

- 性能数据采集工具:

- npu-smi :实时监控芯片功耗、温度、计算单元利用率等宏观指标;

- CANN Profiler:采集细粒度性能数据,包括算子总耗时、计算耗时、数据搬运耗时、缓存命中率、指令执行效率等;

- aclrtEventRecord / aclrtEventSynchronize :通过事件同步机制,手动标记关键代码段的执行时间,精准测量各模块耗时占比。

- 性能瓶颈分析方法:

- 耗时占比分析:若数据搬运耗时占比≥40%,则优化Tiling策略(增大Tile尺寸、减少搬运次数)或DMA搬运路径;若计算耗时占比≥60%,则优化核心运算逻辑(如使用Ascend C硬件加速指令、提升并行度);

- 缓存命中率分析:若L1缓存命中率<90%,则减小Tile尺寸或优化数据访问顺序(如按行优先访问适配缓存行);若L2缓存命中率<80%,则优化全局内存访问模式(如连续访问而非随机访问);

- 计算单元利用率分析:若利用率<80%,则检查Tiling策略是否存在负载不均衡,或是否存在同步等待过多的问题,可通过异步执行、流水线调度优化。

(4)仿真调试:降低硬件依赖

- 借助CANN提供的设备仿真环境(无需实际昇腾芯片),模拟AI Core的执行流程,支持功能调试与初步性能评估;

- 仿真环境支持单步执行、寄存器查看、内存访问跟踪等功能,可快速定位硬件相关的错误(如不支持的指令、内存对齐问题)。

3. 典型问题排查流程与案例

(1)功能错误:内存越界

- 现象:算子执行时报 ACL_ERROR_MEMORY_OUT_OF_BOUNDS 错误;

- 排查流程:

1. 在数据访问处添加日志,打印访问索引与张量尺寸(如 ASC_LOG_DEBUG("Index: %u, Size: %u", tid, size) );

2. 发现 tid 超出张量实际尺寸,定位到Tiling计算时Tile数量计算错误;

3. 修正Tiling逻辑(如将 tileNum = (size + tileSize) / tileSize 改为 tileNum = (size + tileSize - 1) / tileSize );

4. 重新测试,确认错误消失。

(2)精度偏差:FP16计算结果与CPU偏差过大

- 现象:算子输出与CPU参考结果的相对误差达到5%,超出阈值;

- 排查流程:

1. 逐层打印中间结果,发现偏差出现在核心运算步骤;

2. 检查核心运算代码,发现使用了普通加法指令而非Ascend C优化指令;

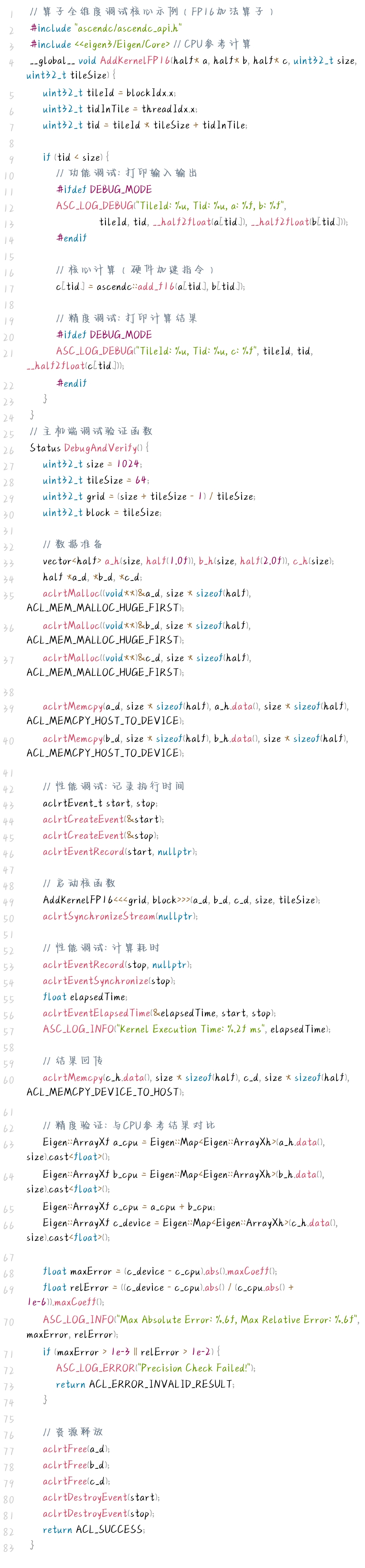

3. 将 c[tid] = a[tid] + b[tid] 改为 c[tid] = ascendc::add_f16(a[tid], b[tid]) (硬件加速指令);

4. 重新比对,误差降至0.8%,符合要求。

(3)性能瓶颈:数据搬运耗时占比过高

- 现象:算子总耗时10ms,其中数据搬运耗时6ms,占比60%;

- 排查流程:

1. 通过Profiler分析,发现Tile尺寸过小(32×32),导致数据搬运次数过多;

2. 结合L1缓存容量,将Tile尺寸调整为64×64,减少搬运次数;

3. 启用DMA多通道并行搬运,将数据搬运耗时降至2ms,总耗时优化至4ms。

4. 极简示例代码(含功能+精度+性能调试)

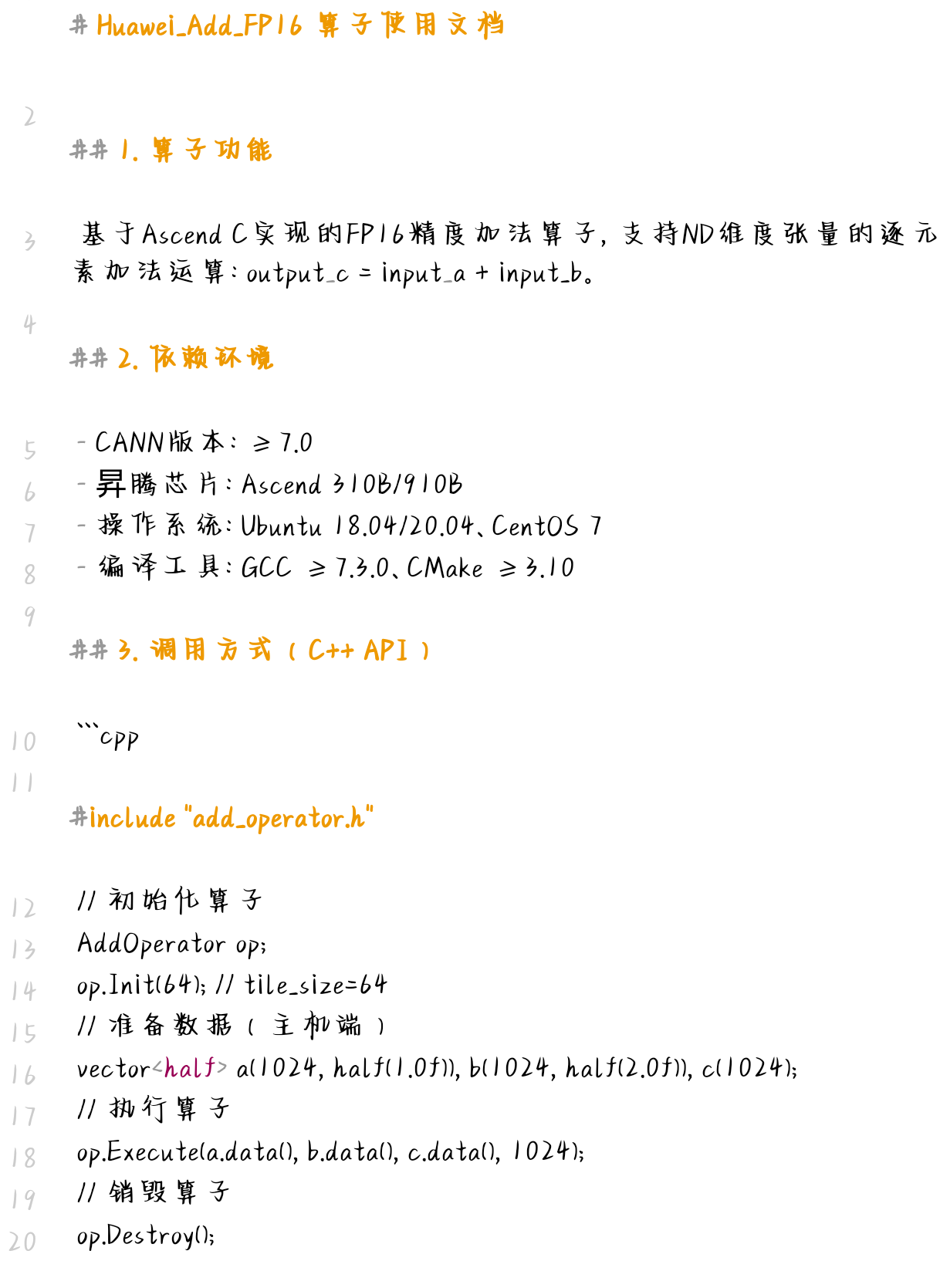

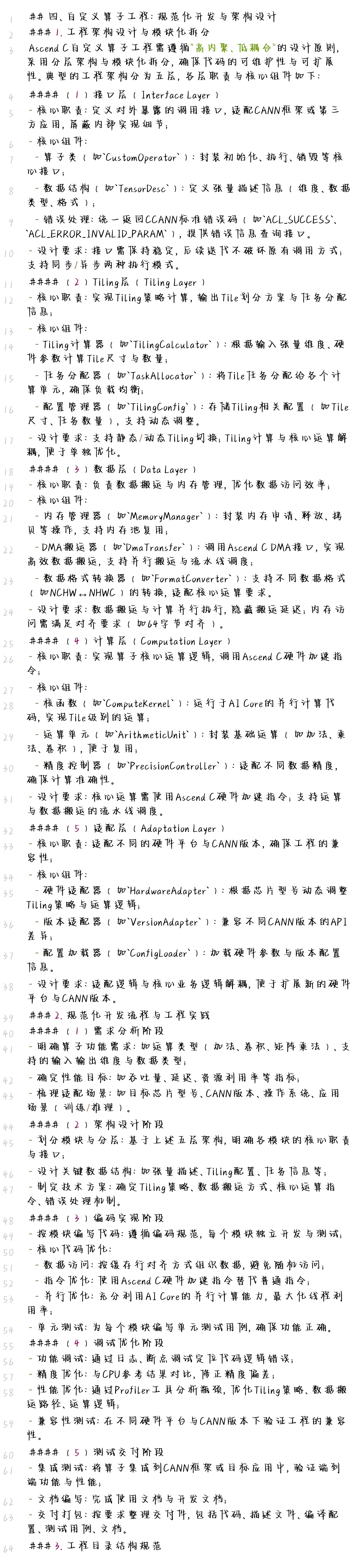

三、算子交付件:标准化输出与合规要求

1. 交付件核心组成与技术规范

Ascend C算子交付件需满足CANN框架的集成要求,确保能够无缝接入训练/推理流程,核心包含六大组件,各组件的技术规范与设计要点如下:

(1)算子代码文件(核心组件)

- 文件格式:.h(接口声明)、.cpp/.cc(实现代码)、.cu(核函数代码,如需);

- 代码规范:

- 接口遵循CANN算子API规范,类名、函数名采用"驼峰命名法"(如 CustomAddOperator ),常量采用"全大写+下划线"(如 MAX_TILE_SIZE );

- 核心逻辑需包含Tiling计算、数据搬运、核心运算、错误处理四大模块,每个模块独立封装,便于维护;

- 注释需包含函数功能、参数说明、返回值含义、关键逻辑解释(如Tiling策略的设计思路),复杂算法需添加数学公式注释。

- 依赖要求:仅依赖Ascend C核心库( ascendc_api.h )、CANN基础库( acl/acl.h ),禁止依赖第三方非开源库。

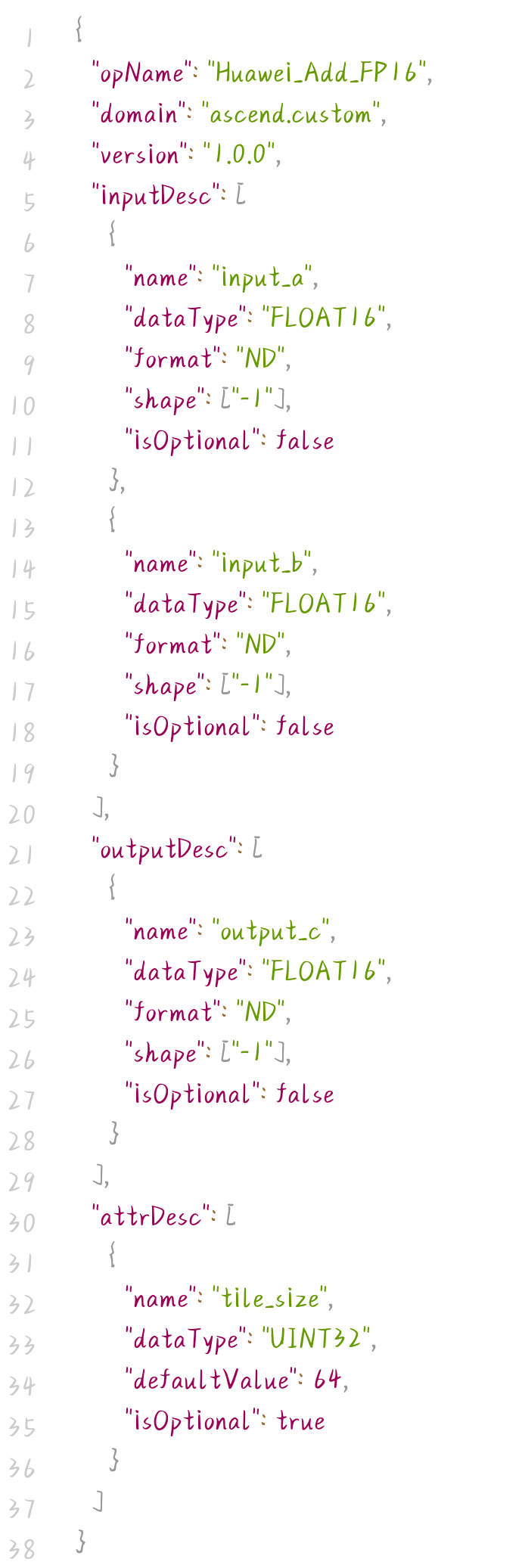

(2)算子描述文件(JSON格式)

- 核心作用:向CANN框架声明算子的输入输出规格、属性参数、支持的数据类型与格式,是框架解析算子的依据;

- 必填字段:

- opName :算子名称(需唯一,格式为"厂商名_功能_精度",如"Huawei_Add_FP16");

- domain :算子所属领域(如"ai.onnx"、"ascend.custom");

- version :算子版本(如"1.0.0");

- inputDesc :输入张量描述数组,每个元素包含 name (名称)、 dataType (数据类型,如"FLOAT16")、 format (数据格式,如"NCHW")、 shape (维度,支持动态维度用"-1"表示)、 isOptional (是否可选,默认false);

- outputDesc :输出张量描述数组,字段与 inputDesc 一致;

- attrDesc :属性参数描述数组(如Tile尺寸、计算精度模式),包含 name 、 dataType 、 defaultValue (默认值)、 isOptional (是否可选);

- 规范要求:数据类型与格式需严格遵循CANN定义(如数据类型支持"FLOAT"、"FLOAT16"、"INT8"等,格式支持"NCHW"、"NHWC"、"ND"等),禁止自定义非标准类型。

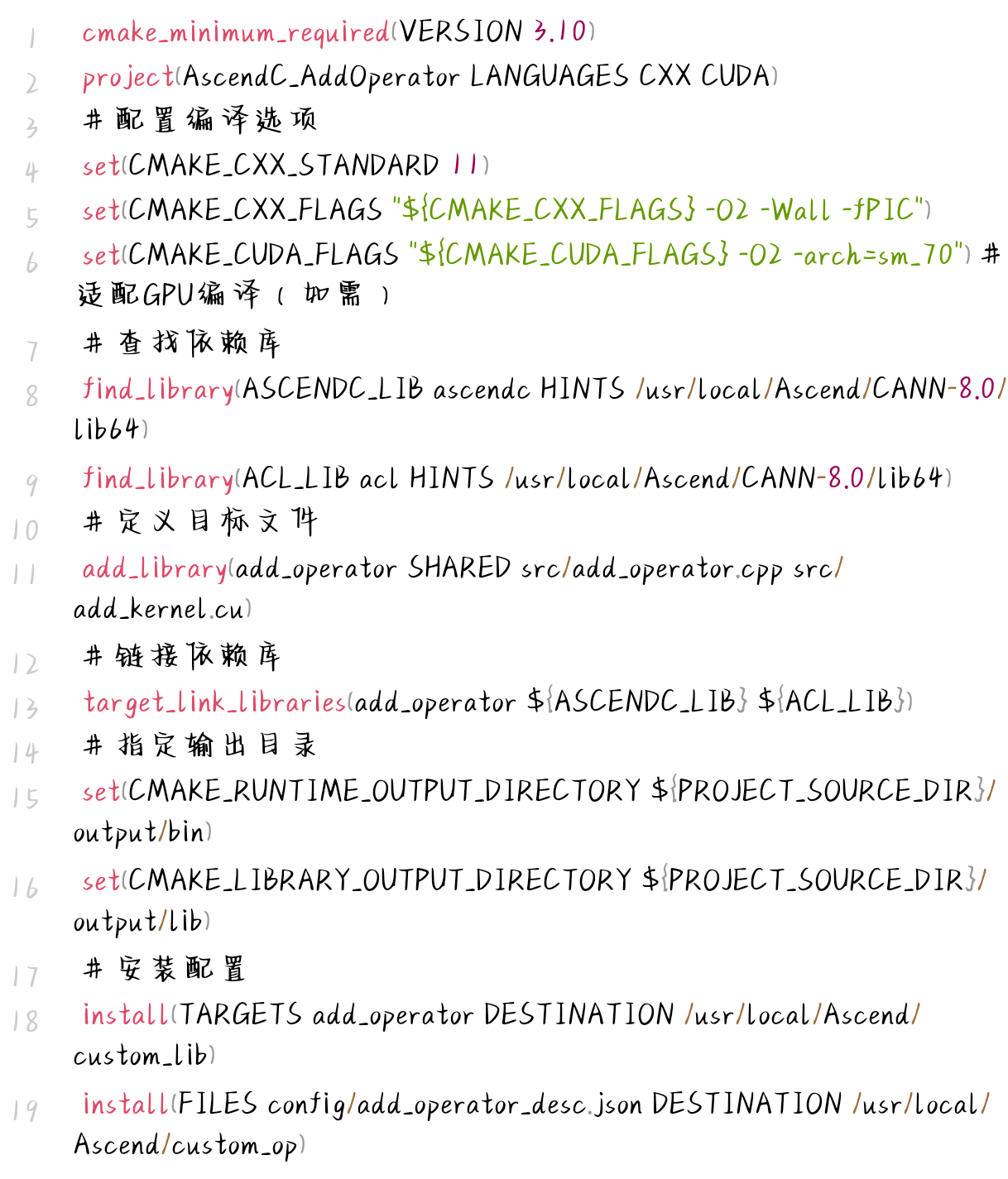

(3)编译配置文件

- 支持格式:CMakeLists.txt(推荐)、Makefile;

- CMakeLists.txt核心配置:

- 指定C++标准(如C++11及以上);

- 链接Ascend C库与CANN库(如 target_link_libraries(${TARGET_NAME} ascendc acl) );

- 定义编译选项(如 -O2 优化级别、 -DDEBUG_MODE 调试开关、 -march=native 硬件架构适配);

- 指定输出目录(如 set(CMAKE_RUNTIME_OUTPUT_DIRECTORY ${PROJECT_SOURCE_DIR}/output) );

- 兼容性要求:支持在x86_64、ARM架构下编译,兼容GCC 7.3.0及以上版本。

(4)测试用例与报告

- 测试用例分类:

- 功能测试用例:覆盖正常场景(典型输入尺寸、常用数据类型)、边界场景(最小输入尺寸、最大输入尺寸、零值输入)、异常场景(无效数据类型、超出支持维度范围);

- 精度测试用例:针对每种支持的数据类型,设计至少3组不同规模的输入,与CPU参考结果(如Eigen、MKL库计算结果)对比;

- 性能测试用例:包含吞吐量测试(固定输入尺寸,统计每秒处理数据量)、延迟测试(单批次输入,统计平均执行时间)、稳定性测试(连续运行12小时,检查是否有崩溃或性能衰减);

- 测试报告:需包含测试环境(CANN版本、昇腾芯片型号、操作系统版本)、测试用例清单、测试结果(通过率、精度误差、性能指标)、问题与改进建议。

(5)文档说明

- 使用文档:面向算子使用者,包含算子功能介绍、调用方式(C/C++ API、模型集成方式)、参数说明(输入输出、属性参数)、使用示例代码、注意事项(如数据格式要求、依赖环境);

- 开发文档:面向算子维护者,包含需求分析、架构设计(模块划分、流程图)、Tiling策略设计、核心算法原理、性能优化思路、版本迭代记录。

(6)兼容性测试报告

- 核心内容:验证算子在不同CANN版本(如7.0、8.0)、不同昇腾芯片型号(如310B、910B)、不同操作系统(Ubuntu 18.04/20.04、CentOS 7)下的兼容性;

- 测试指标:功能通过率(目标100%)、性能波动范围(目标≤10%)、无编译错误与运行时异常。

2. 合规性核心要求与检测标准

算子交付件需通过CANN生态的合规性检测,核心要求包括:

(1)功能完整性

- 支持声明的所有输入输出尺寸、数据类型与格式,无功能缺失;

- 边界场景(如输入尺寸为1、数据值为0或最大值)无崩溃、无输出错误;

- 异常处理机制完善,对无效输入(如空指针、数据类型不匹配)能返回明确错误码(遵循CANN错误码规范),且无内存泄漏。

(2)性能达标要求

- 吞吐量:需满足目标场景要求(如推理算子吞吐量≥1000 QPS),且不低于CANN内置同类算子的80%;

- 延迟:单批次执行时间需满足目标场景要求(如推理算子延迟≤1ms);

- 资源利用率:AI Core利用率≥80%,内存带宽利用率≥70%(通过Profiler检测);

- 性能稳定性:连续运行12小时,吞吐量波动≤5%,无性能衰减。

(3)兼容稳定性

- 框架兼容:支持指定的CANN版本范围(如≥7.0),无API调用不兼容问题;

- 硬件兼容:适配目标芯片型号(如310B、910B),无硬件指令不支持错误;

- 运行稳定性:长时间运行无崩溃、无死锁、无内存泄漏(通过 valgrind 、 npu-memcheck 工具检测)。

(4)安全可靠性

- 内存安全:无数组越界、空指针访问、内存泄漏等问题;

- 数据安全:支持数据加密传输(如需),无敏感数据泄露风险;

- 权限合规:算子运行所需的系统权限≤普通用户权限,禁止申请root权限。

(5)可维护性

- 代码质量:通过代码静态检测工具(如CppCheck),无高危告警;

- 注释覆盖率:核心代码注释覆盖率≥80%;

- 文档完整性:使用文档与开发文档齐全,便于使用者快速上手与后续迭代。

3. 极简示例代码(完整交付件核心文件)

(1)算子描述文件(add_operator_desc.json)

(2)编译配置文件(CMakeLists.txt)

(3)使用文档示例(README.md)

4. 参数说明

表格

参数名 类型 描述 是否必填

input_a half* 输入张量a(FP16) 是

input_b half* 输入张量b(FP16) 是

output_c half* 输出张量c(FP16) 是

size uint32_t 张量元素个数 是

tile_size uint32_t Tile尺寸(默认64) 否

5. 注意事项

- 输入张量a和b的维度与元素个数必须一致;

- 支持的最大元素个数为10^8,超出需调整tile_size参数;

- 数据格式仅支持ND,如需其他格式(如NCHW)需提前转换。

CustomOperator/

├── src/ # 源代码目录

│ ├── interface/ # 接口层代码

│ │ ├── custom_operator.h # 算子接口声明

│ │ └── tensor_desc.h # 张量描述数据结构

│ ├── tiling/ # Tiling层代码

│ │ ├── tiling_calculator.cpp # Tiling计算逻辑

│ │ └── task_allocator.cpp # 任务分配逻辑

│ ├── data/ # 数据层代码

│ │ ├── memory_manager.cpp # 内存管理

│ │ └── dma_transfer.cpp # DMA搬运

│ ├── computation/ # 计算层代码

│ │ ├── compute_kernel.cu # 核函数实现

│ │ └── arithmetic_unit.cpp # 基础运算封装

│ └── adaptation/ # 适配层代码

│ ├── hardware_adapter.cpp # 硬件适配

│ └── version_adapter.cpp # 版本适配

├── config/ # 配置文件目录

│ └── operator_desc.json # 算子描述文件

├── test/ # 测试用例目录

│ ├── functional_test/ # 功能测试

│ ├── precision_test/ # 精度测试

│ └── performance_test/ # 性能测试

├── doc/ # 文档目录

│ ├── user_guide.md # 使用文档

│ └── dev_guide.md # 开发文档

├── CMakeLists.txt # 编译配置文件

└── README.md # 工程说明文档

五、算子调用:全流程适配与实践指南

1. 核心调用流程与技术细节

Ascend C算子的调用需依托CANN框架完成主机端与设备端的协同,核心流程分为初始化、数据准备、算子执行、结果处理、资源释放五个阶段,每个阶段的技术细节与注意事项如下:

(1)初始化阶段

- 核心任务:加载CANN框架、初始化设备环境、创建算子实例;

- 关键步骤:

1. 初始化CANN框架:调用 aclInit(nullptr) ,传入配置文件路径(可选);

2. 设置设备:调用 aclrtSetDevice(deviceId) ,指定使用的昇腾芯片设备ID;

3. 创建执行流:调用 aclrtCreateStream(&stream) ,用于管理算子执行的异步任务;

4. 初始化算子:创建算子实例,调用 Init() 接口,传入Tile尺寸、精度模式等配置参数;

- 技术细节:

- 执行流可创建多个,用于并行执行多个算子;

- 算子初始化时需完成资源预分配(如内存池初始化),减少执行时的开销;

- 若需支持动态批处理,算子初始化时应避免绑定固定输入尺寸。

(2)数据准备阶段

- 核心任务:主机端准备数据、内存申请、数据拷贝至设备端;

- 关键步骤:

1. 主机端数据准备:创建输入输出数据缓冲区,填充输入数据(如从文件读取、网络接收);

2. 设备端内存申请:调用 aclrtMalloc() 申请设备内存,指定内存分配策略(如 ACL_MEM_MALLOC_HUGE_FIRST 优先使用大页内存);

3. 数据拷贝:调用 aclrtMemcpyAsync() (异步)或 aclrtMemcpy() (同步)将主机端数据拷贝至设备端;

- 技术细节:

- 内存申请时需确保尺寸足够,且满足数据对齐要求(如64字节对齐);

- 异步拷贝需配合执行流使用,可与算子执行并行,提升效率;

- 对于重复使用的数据(如权重张量),可在初始化阶段完成拷贝,避免重复搬运。

(3)算子执行阶段

- 核心任务:调用算子执行接口,完成计算;

- 关键步骤:

1. 设置算子参数:传入设备端输入输出内存地址、数据尺寸、属性参数(如Tile尺寸);

2. 执行算子:调用 Execute() 接口,同步执行或异步执行;

3. 等待执行完成:同步执行无需额外操作,异步执行需调用 aclrtSynchronizeStream(stream) 等待流完成;

- 技术细节:

- 异步执行时,算子执行与数据拷贝可并行,需合理设计任务依赖关系(如通过 aclrtStreamWaitEvent 设置事件同步);

- 批量执行时,可优化Tile划分与任务调度,提升吞吐量;

- 执行过程中需检查返回值,及时处理错误(如算子执行失败时释放已申请的资源)。

(4)结果处理阶段

- 核心任务:将设备端计算结果拷贝至主机端,进行后续处理;

- 关键步骤:

1. 数据拷贝:调用 aclrtMemcpyAsync() 或 aclrtMemcpy() 将设备端输出数据拷贝至主机端;

2. 结果验证:(可选)与CPU参考结果对比,验证计算准确性;

3. 后续处理:如将结果写入文件、发送至网络、作为下一个算子的输入;

- 技术细节:

- 若后续处理无需主机端干预,可直接将结果作为设备端输入传递给下一个算子,避免不必要的拷贝;

- 结果验证仅在调试或测试阶段需要,生产环境可关闭以提升性能。

(5)资源释放阶段

- 核心任务:释放设备内存、执行流、算子实例等资源;

- 关键步骤:

1. 释放设备内存:调用 aclrtFree() 释放设备端输入输出内存;

2. 销毁执行流:调用 aclrtDestroyStream(stream) ;

3. 销毁算子实例:调用 Destroy() 接口释放算子内部资源;

4. 重置设备:调用 aclrtResetDevice(deviceId) 释放设备资源;

5. 终⽌CANN框架:调用 aclFinalize() ;

- 技术细节:

- 资源释放需按"先申请后释放"的顺序,避免内存泄漏;

- 若程序异常退出,需在异常处理逻辑中释放已申请的资源。

2. 主流调用方式与场景适配

(1)直接调用(C/C++ API)

- 适用场景:自定义推理管线、高性能计算应用,需要直接控制算子执行流程;

- 优势:灵活性高,可深度优化执行流程(如算子融合、异步调度);

- 关键要点:

- 需手动管理设备内存、执行流等资源;

- 支持单算子执行与多算子流水线执行;

- 示例代码:见本节"极简示例代码"。

(2)模型集成调用

- 适用场景:深度学习训练/推理,需将自定义算子集成到ONNX/TensorFlow/PyTorch模型中;

- 核心流程:

1. 封装算子为框架兼容格式(如ONNX自定义算子、TensorFlow插件);

2. 在模型中调用自定义算子(如通过ONNX的 CustomOp 节点);

3. 借助CANN框架的模型转换工具(如 atc )将模型转换为昇腾芯片可执行格式;

4. 加载转换后的模型,执行推理/训练;

- 优势:无需手动管理资源,可与框架内置算子无缝协同;

- 关键要点:

- 算子描述文件需符合框架规范(如ONNX自定义算子的属性定义);

- 需确保算子与框架的数据流格式一致(如TensorFlow的NHWC格式)。

(3)批量调用

- 适用场景:高吞吐量场景(如大规模数据处理、批量推理)

2025年昇腾CANN训练营第二季,基于CANN开源开放全场景,推出0基础入门系列、码力全开特辑、开发者案例等专题课程,助力不同阶段开发者快速提升算子开发技能。获得Ascend C算子中级认证,即可领取精美证书,完成社区任务更有机会赢取华为手机,平板、开发板等大奖。\n\n \n\n报名链接:https://www.hiascend.com/developer/activities/cann20252

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)