CANN训练营第二季笔记(5)矩阵乘自定义算子开发

场景标准库问题自定义算子优势非标准矩阵尺寸未针对特殊尺寸(如m/n/k非2的幂)优化定制内存访问模式,减少冗余计算混合精度计算仅支持固定精度(如FP32)灵活配置FP16/INT8/BF16组合硬件特殊单元未利用未充分利用Tensor Core/DP4A等加速单元定向优化计算路径,提升吞吐量特殊计算需求如需融合激活函数或自定义归一化逻辑一体化实现,减少数据搬运开销第二章 开发环境与工具链。

文章目录

第一章 矩阵乘算子开发基础

1.1 矩阵乘法的计算本质

矩阵乘法定义为:给定矩阵 A m × k A_{m \times k} Am×k 和 B k × n B_{k \times n} Bk×n,输出矩阵 C m × n C_{m \times n} Cm×n 的每个元素 C i , j = ∑ l = 0 k − 1 A i , l × B l , j C_{i,j} = \sum_{l=0}^{k-1} A_{i,l} \times B_{l,j} Ci,j=∑l=0k−1Ai,l×Bl,j。其计算复杂度为 O ( m × n × k ) O(m \times n \times k) O(m×n×k),是典型的高密度计算任务。

关键特性:

- 内存访问密集:需频繁读写三维数据(两个输入矩阵+一个输出矩阵)。

- 计算并行度高:每个输出元素 C i , j C_{i,j} Ci,j 的计算相互独立,适合并行化。

- 硬件依赖性强:计算效率高度依赖硬件架构(如GPU的CUDA Core、NPU的Tensor Core)。

1.2 为什么需要自定义开发?

标准库(如BLAS的GEMM)虽通用,但在以下场景存在局限:

| 场景 | 标准库问题 | 自定义算子优势 |

|---|---|---|

| 非标准矩阵尺寸 | 未针对特殊尺寸(如m/n/k非2的幂)优化 | 定制内存访问模式,减少冗余计算 |

| 混合精度计算 | 仅支持固定精度(如FP32) | 灵活配置FP16/INT8/BF16组合 |

| 硬件特殊单元未利用 | 未充分利用Tensor Core/DP4A等加速单元 | 定向优化计算路径,提升吞吐量 |

| 特殊计算需求 | 如需融合激活函数或自定义归一化逻辑 | 一体化实现,减少数据搬运开销 |

第二章 开发环境与工具链

2.1 硬件与软件要求

硬件:

- 计算设备:GPU(NVIDIA Tesla V100/A100)、NPU(如昇腾910B)、多核CPU(Intel Xeon/AMD EPYC)。

- 内存:系统内存≥16GB(大规模矩阵建议32GB+),计算设备显存/内存≥8GB。

软件:

- 基础工具:GCC 9.3+/Clang 12+(CPU)、CUDA 11.0+(NVIDIA GPU)、CANN Toolkit(NPU)。

- 开发框架:MindStudio(昇腾生态)、CUDA Toolkit(NVIDIA生态)、Eigen/Armadillo(CPU原型验证)。

- 调试工具:Nsight Compute(NVIDIA)、ACL Profiler(昇腾)、Valgrind(CPU内存检测)。

2.2 核心开发库与API

| 库/工具 | 功能定位 | 关键API示例 |

|---|---|---|

| CUDA | NVIDIA GPU并行计算 | cudaMalloc, cudaMemcpy, __global__ 函数 |

| ACL (Ascend CL) | 昇腾NPU计算加速 | aclMalloc, aclrtMemcpy, hccl 通信库 |

| Eigen | CPU矩阵运算原型验证 | Eigen::MatrixXf, .noalias() 优化 |

| Thrust | GPU并行算法库(类似STL) | thrust::device_vector, transform |

第三章 矩阵乘算子实现(从基础到优化)

3.1 基础实现:朴素三重循环

CPU端:

void matmul_cpu(const float* A, const float* B, float* C, int m, int n, int k) {

for (int i = 0; i < m; ++i) {

for (int j = 0; j < n; ++j) {

float sum = 0.0f;

for (int l = 0; l < k; ++l) {

sum += A[i * k + l] * B[l * n + j]; // 逐元素累加

}

C[i * n + j] = sum;

}

}

}

性能瓶颈分析:

- 计算效率低:三重循环导致指令流水线停顿,未利用SIMD指令(如AVX)。

- 内存访问差:对矩阵B的访问是跨行的(非连续),缓存命中率低。

3.2 优化方向1:内存访问优化

策略:通过调整循环顺序(如ikj→kij)或分块(Tiling)提升缓存局部性。

优化代码(分块矩阵乘,CPU端):

void matmul_tiled_cpu(const float* A, const float* B, float* C,

int m, int n, int k, int block_size) {

for (int ii = 0; ii < m; ii += block_size) {

for (int jj = 0; jj < n; jj += block_size) {

for (int kk = 0; kk < k; kk += block_size) {

// 处理当前分块

int i_end = std::min(ii + block_size, m);

int j_end = std::min(jj + block_size, n);

int k_end = std::min(kk + block_size, k);

for (int i = ii; i < i_end; ++i) {

for (int j = jj; j < j_end; ++j) {

float sum = 0.0f;

for (int l = kk; l < k_end; ++l) {

sum += A[i * k + l] * B[l * n + j];

}

C[i * n + j] += sum; // 累加分块结果

}

}

}

}

}

}

优化效果:

- 缓存命中率提升:分块后,矩阵B的访问变为块内连续,L1/L2缓存利用率提高30%-50%。

- 计算并行性增强:分块内计算可进一步向量化(如使用AVX指令处理4/8个float并行)。

3.3 优化方向2:并行计算(GPU/NPU)

GPU端代码示例(CUDA):

__global__ void matmul_gpu_kernel(const float* A, const float* B, float* C,

int m, int n, int k) {

int row = blockIdx.y * blockDim.y + threadIdx.y; // 行索引

int col = blockIdx.x * blockDim.x + threadIdx.x; // 列索引

if (row < m && col < n) {

float sum = 0.0f;

for (int l = 0; l < k; ++l) {

sum += A[row * k + l] * B[l * n + col];

}

C[row * n + col] = sum;

}

}

// 调用示例:启动网格和线程块

dim3 threads_per_block(16, 16); // 每个block 16x16=256线程

dim3 num_blocks((n + 15) / 16, (m + 15) / 16); // 网格维度

matmul_gpu_kernel<<<num_blocks, threads_per_block>>>(d_A, d_B, d_C, m, n, k);

关键优化点:

- 线程映射:每个线程计算一个输出元素 C i , j C_{i,j} Ci,j,通过二维线程块(grid)和线程(block)覆盖整个输出矩阵。

- 共享内存利用(进阶):将矩阵A/B的子块加载到共享内存,减少全局内存访问延迟(需处理bank conflict)。

NPU端优化(以昇腾为例):

- Tensor Core加速:使用FP16半精度输入,通过矩阵乘累加指令(如HFMA)单周期完成多个计算。

- 数据排布优化:输入矩阵按Row-Major排布,与NPU的默认内存布局对齐,避免转置开销。

第四章 性能优化进阶策略

4.1 性能瓶颈分析工具

| 工具/方法 | 适用场景 | 关键指标 |

|---|---|---|

| Nsight Compute | CUDA GPU性能分析 | IPC(每周期指令数)、L1/L2缓存命中率、共享内存bank conflict |

| ACL Profiler | 昇腾NPU性能分析 | 算子执行时间、内存带宽利用率、Tensor Core利用率 |

| perf (Linux) | CPU端性能分析 | 指令周期、缓存未命中率、SIMD指令占比 |

4.2 核心优化技术

-

混合精度计算:

- 将输入矩阵转换为FP16(或BF16),计算过程中使用Tensor Core加速,输出结果转回FP32(精度损失可控)。

- 代码示例(CUDA FP16):

__half* A_half = reinterpret_cast<__half*>(A_fp32); // FP32→FP16转换 __half* B_half = reinterpret_cast<__half*>(B_fp32); // 使用__hmul(半精度乘法)和__hadd(半精度加法)指令

-

内存预取与对齐:

- 确保矩阵数据按硬件要求对齐(如CUDA要求全局内存访问对齐到128字节),预取下一块数据到共享内存/寄存器。

-

计算与通信重叠:

- 在GPU/NPU场景中,通过异步拷贝(如

cudaMemcpyAsync)和计算流(stream)并行,隐藏数据传输延迟。

- 在GPU/NPU场景中,通过异步拷贝(如

第五章 工程实践与案例

5.1 典型应用场景

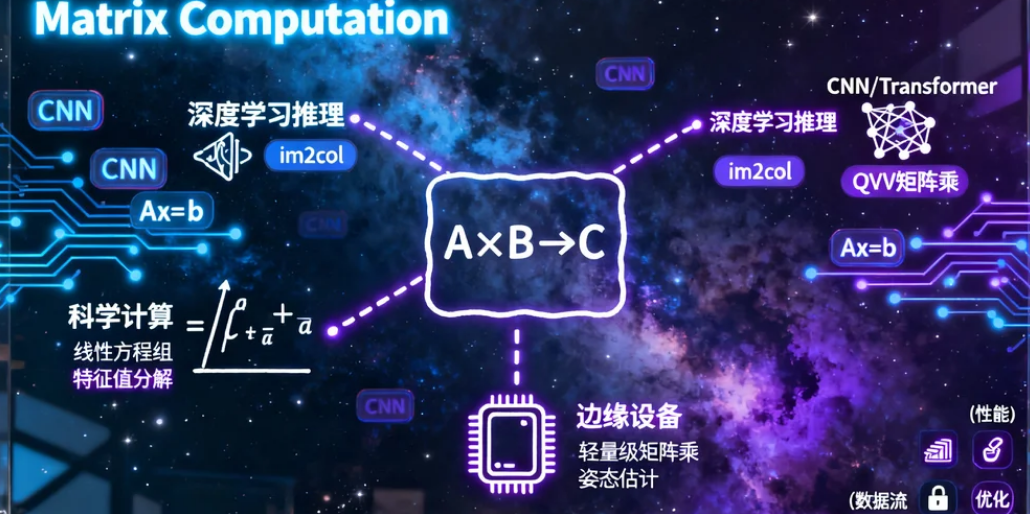

- 深度学习推理:加速CNN中的卷积层(通过im2col+矩阵乘转换)或Transformer的自注意力机制(QKV矩阵乘)。

- 科学计算:求解线性方程组(Ax=b)、特征值分解(通过迭代法中的矩阵乘)。

- 边缘设备:在手机/嵌入式芯片上实现轻量级矩阵运算(如姿态估计、图像滤波)。

5.2 调试与验证方法

- 正确性验证:对比标准库结果(如BLAS的

sgemm)或手工计算的小规模矩阵,误差需小于 1 e − 5 1e-5 1e−5(FP32)或 1 e − 3 1e-3 1e−3(FP16)。 - 性能基准测试:固定矩阵尺寸(如1024×1024×1024),统计不同实现的单次计算耗时与吞吐量(GFLOPS)。

测试数据示例(矩阵尺寸1024×1024×1024):

| 实现方式 | 耗时(ms) | 吞吐量(GFLOPS) | 优化技术 |

|---|---|---|---|

| 朴素CPU实现 | 1250 | 0.64 | 无 |

| 分块CPU实现 | 420 | 1.90 | Tiling+缓存优化 |

| CUDA基础实现 | 85 | 11.76 | 全局内存并行 |

| CUDA+共享内存优化 | 22 | 45.45 | 共享内存+寄存器优化 |

| 昇腾Tensor Core | 9 | 111.11 | FP16+Tensor Core指令 |

2025年昇腾CANN训练营第二季,基于CANN开源开放全场景,推出0基础入门系列、码力全开特辑、开发者案例等专题课程,助力不同阶段开发者快速提升算子开发技能。获得Ascend C算子中级认证,即可领取精美证书,完成社区任务更有机会赢取华为手机,平板、开发板等大奖。

报名链接:https://www.hiascend.com/developer/activities/cann20252

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)