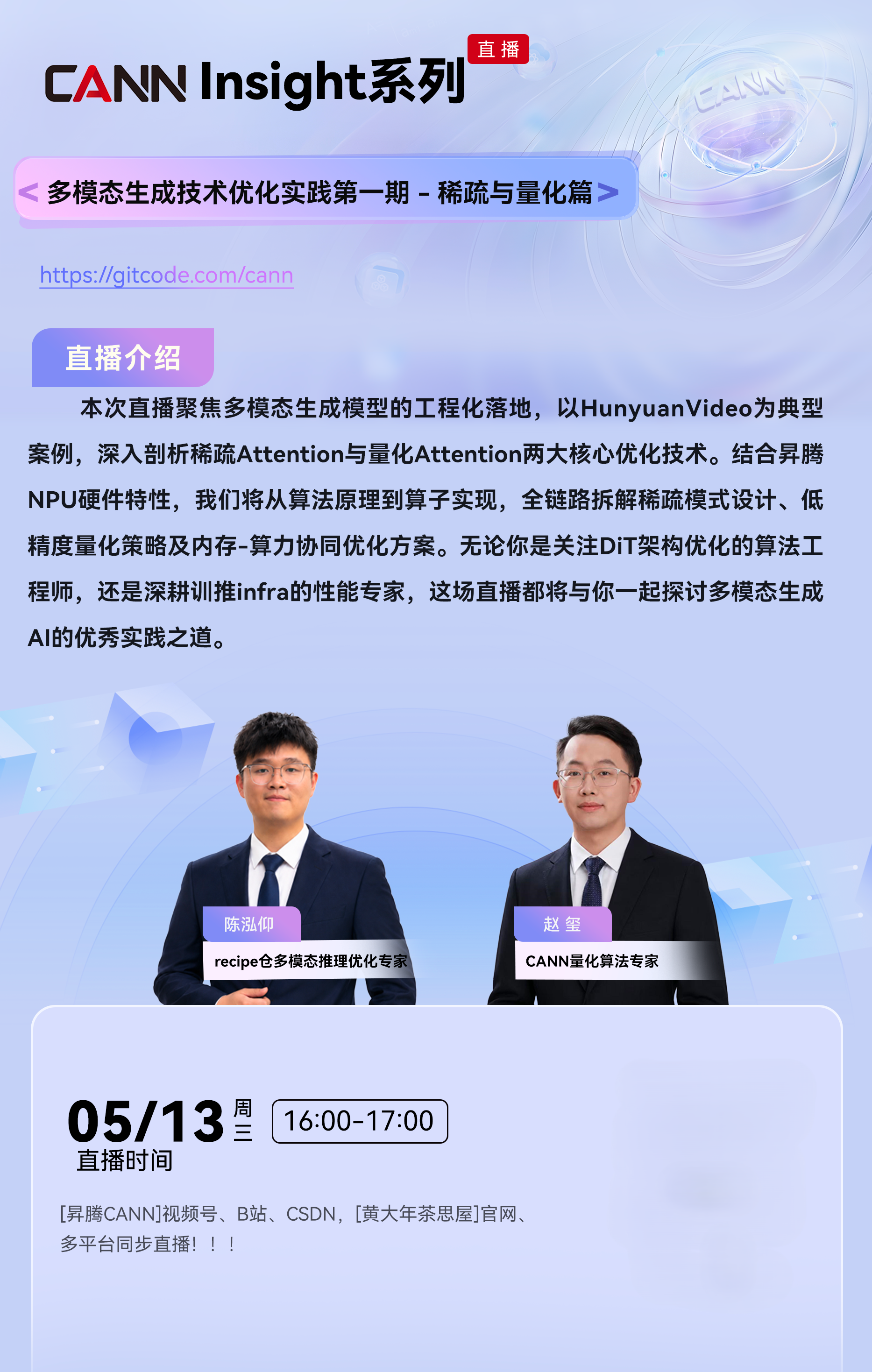

5月13日直播丨多模态生成技术优化实践第一期-稀疏与量化篇

·

多模态生成推理优化的"三板斧":算得轻、算得少、算得巧

随着多模态生成模型参数量与序列长度持续攀升,高分辨率长时视频生成的推理面临的长序列挑战日益严峻。如何在保证生成质量的前提下,走通高性能与低占存的算法与工程化路径?

本次直播以典型开源模型为例,带大家了解如何在昇腾上实践多模态生成的典型优化:稀疏Attention模式设计、量化Attention低精度策略、分布式并行方案选型,以及DiT层级特征Cache与复用机制。结合昇腾NPU集群通信拓扑与CANN软件栈特性,从算法原理到算子落地,分享多模态生成的全栈适配经验与可复现的优化方法论,帮助多模态生成模型“算得轻,算得少,算得巧”。

干货密集,从稀疏量化到并行和缓存复用,带你走通多模态生成Infra的实践落地路径。敬请期待。

欢迎锁定直播间,一起探讨视频生成模型的工程化解法。

通过本次直播,我们希望能和大家一起学习:

- 了解稀疏Attention在视频生成模型中的模式设计原理,理解如何在长序列建模与计算效率之间取得平衡;

- 学习量化Attention在昇腾NPU上的落地策略,在低精度约束下保持生成质量的同时获取加速收益;

- 了解面向多模态生成的分布式并行(SP、CFGP等),充分利用多卡环境机并行加速计算;

- 理解DiT层级特征Cache复用机制,如何利用扩散模型自身特点进行优化,并缓解cache内存问题;

相关样例已在https://gitcode.com/cann/cann-recipes-infer 开源。欢迎行业开发者交流和提交多模态生成Infra的实践经验,共促训推优化生态繁荣。

B站预约链接:点击预约

更多推荐

已为社区贡献220条内容

已为社区贡献220条内容

所有评论(0)