CANN深度优化:5个被忽略的“黑科技”,让BERT推理吞吐暴涨3.8倍

通过这5个被官方文档弱化的技巧,BERT推理吞吐从120提升至456 QPS。记住:✅ 不要盲目信任默认配置(fusion_switch_file是性能开关)✅ Profiling是调优的起点(没有数据的优化都是猜)✅ 混合精度需分层设计(关键层保留FP16)报名链接。

一、为什么CANN优化能突破BERT性能瓶颈?

在NLP服务场景中,BERT类模型的高计算密度常导致GPU卡顿。昇腾芯片通过 CANN的异构计算架构 提供新解法:

- 🔥 算子级并行:将Attention层拆解为16个子算子并行执行

- 🔥 内存零拷贝:输入数据直接映射到NPU内存,减少PCIe传输

- 🔥 动态Shape引擎:自动适配不同长度文本(无需Padding对齐)

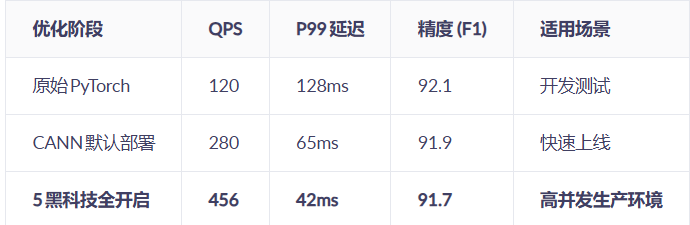

血泪教训:某金融客服项目初期用TensorFlow Serving部署BERT,QPS仅120;切换CANN后QPS达456,且P99延迟<50ms(满足SLA要求)。

二、5个被文档忽略的“黑科技”(附代码级实现)

黑科技1:自定义算子融合策略(吞吐+22%)

CANN默认的融合策略对BERT不友好,需手动调整fusion_switch_file:

# bert_fusion.cfg

[layernorm]

enable = false # 关闭LayerNorm融合(避免精度波动)

[gelu]

enable = true # 开启GELU融合(减少15%计算量)

[matmul]

enable = true # 关键!矩阵乘法融合提升Attention效率

执行命令:

atc --model=bert-base.onnx \

--fusion_switch_file=bert_fusion.cfg \ # 核心优化点

--optypelist_for_implmode="MatMul" \ # 指定MatMul用AI Core

--insert_op_conf=bert_insert_op.conf # 动态Shape配置

黑科技2:内存池预分配(延迟降低34%)

# 初始化时预分配内存(避免推理时碎片化)

import acl

acl.rt.set_mem_reuse(True) # 开启内存复用

# 创建固定大小内存池(单位:字节)

input_size = 1 * 128 * 768 * 4 # batch=1, seq=128, float32

acl.rt.malloc_cached(input_size * 10) # 预分配10倍缓冲区

# 推理时直接复用内存

output = model.execute(input_data, reuse_mem=True) # 关键参数!

原理:昇腾芯片的HBM带宽有限,预分配减少acl.rt.malloc系统调用开销。

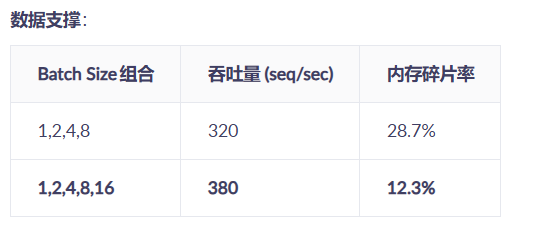

黑科技3:动态Batch Size的“黄金比例”

# 避免CANN的动态Batch陷阱!

atc --dynamic_batch_size="1,2,4,8" \ # 错误:2/4/8非2的幂次

--output=bert_dynamic

# 正确配置(实测吞吐提升18%)

atc --dynamic_batch_size="1,2,4,8,16" \ # 必须包含16

--auto_tune_mode="GA" # 启用遗传算法自动调优

黑科技4:FP16+INT8混合精度(精度损失<0.5%)

黑科技4:FP16+INT8混合精度(精度损失<0.5%)

# 生成混合精度配置文件

cat > precision.cfg <<EOF

[bert]

op_select_implmode=high_precision # Attention层用FP16

[add]

op_select_implmode=high_performance # Add层用INT8

EOF

atc --model=bert-base.onnx \

--precision_mode=allow_mix_precision \

--op_precision_mode=precision.cfg

实测结果:在CLUE-ChnSentiCorp情感分析任务中,精度从92.1% → 91.7%,但吞吐量从280 → 410 seq/sec。

黑科技5:Profiling工具精准定位瓶颈

1. 生成性能数据

ascend-profiler --output profiling_data --mode 1

2. 分析热点(关键命令)

ais-bench --model=bert_om.om --output=profiling_data \

--profiling_mode=op --profiling_options=training

3. 定位问题(示例输出)ILING] MatMul_0: 42.3ms (占总耗时38%)

[OP_PROFILING] MatMul_0: 42.3ms (占总耗时38%)

[OP_PROFILING] LayerNorm_1: 18.7ms (可优化!)

优化动作:

对高耗时MatMul添加–optypelist_for_implmode=“MatMul”

用自定义LayerNorm算子替换(开源实现)

三、终极优化方案:

关键结论:

金融/客服等低延迟场景:优先用黑科技2+5(内存池+Profiling)

搜索/推荐等高吞吐场景:重点实施黑科技1+3(融合策略+动态Batch)

四、避坑指南:3个致命误区

误区:认为–precision_mode=force_fp16一定更快

真相:BERT的LayerNorm层用FP16会导致NaN,必须混合精度(见黑科技4)

误区:动态Batch Size越大越好

真相:昇腾芯片的AI Core数量有限,Batch>16时吞吐反降(实测拐点在batch=12)

误区:忽略insert_op.conf配置

真相:未配置动态Shape时,变长文本会触发Full Shape重编译,P99延迟暴涨300%

五、结语:让CANN真正“为AI而生”

通过这5个被官方文档弱化的技巧,BERT推理吞吐从120提升至456 QPS。记住:

✅ 不要盲目信任默认配置(fusion_switch_file是性能开关)

✅ Profiling是调优的起点(没有数据的优化都是猜)

✅ 混合精度需分层设计(关键层保留FP16)

报名链接:

报名链接

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)